人工智能領域迎來新一輪開源浪潮,DeepSeek正式發布V4系列大模型預覽版,同步開源全部權重。此次發布的雙版本模型——旗艦版V4 PRO與經濟型V4-Flash,分別以1.6萬億和2840億總參數實現百萬token上下文支持,成為繼Gemini、Qwen之后第三個達成該量級的開源模型。更引人注目的是,V4-Flash以每百萬輸出token僅2元人民幣的定價策略,直接對標OpenAI前一日發布的GPT-5.5(30美元/百萬token),形成開源與閉源模型的首次正面價格交鋒。

技術突破層面,V4系列首創混合注意力架構,通過token維度壓縮機制與自研DSA稀疏注意力技術,將長文本處理時的算力消耗降至前代V3.2的27%,KV緩存占用壓縮至10%。配合流形約束超連接(mHC)與Muon優化器,模型在32萬億token數據上完成預訓練,實現百萬上下文場景下的成本重構。官方宣布將該能力作為所有官方服務的標準配置,此舉被視為對行業長文本定價體系的重新校準。

在模型矩陣設計上,DeepSeek采用"雙型號+三模式"架構。V4-Pro定位專業級應用,在數學、STEM及競賽代碼評測中達到開源模型巔峰水平,內部測試顯示其編碼能力超越Claude Sonnet 4.5,接近Opus 4.6非思考模式表現;V4-Flash則以130億激活參數實現接近Pro版的推理性能,特別在簡單Agent任務中表現突出。兩種型號均支持非思考模式(快速響應)、思考模式-高(顯式推理鏈)、思考模式-極限(模型能力邊界探索)三種推理模式,其中極限模式被建議用于復雜Agent場景開發。

定價策略凸顯DeepSeek的生態野心。V4-Flash以1元輸入(緩存命中0.2元)、2元輸出的價格體系,將萬億參數模型調用成本壓縮至行業最低水平;V4-Pro雖當前定價較高(輸入12元/輸出24元),但官方承諾下半年算力擴容后將大幅下調。特別設計的緩存折扣機制(Flash緩存命中價僅為未命中1/5,Pro為1/12),精準匹配Agent類應用將固定內容置于請求頭部的調用模式,形成"基礎版鋪量+專業版攻堅+緩存降本"的組合策略。

應用層適配成為V4系列核心戰略。模型針對Claude Code、OpenClaw等主流Agent產品進行專項優化,在Agentic Coding評測中創下開源模型最佳紀錄。這種選擇折射出DeepSeek的定位轉型——放棄與Anthropic、Cursor等應用層巨頭直接競爭,轉而成為Agent時代的基礎設施供應商。通過長上下文能力與極低調用成本,解決開發者在代碼倉庫管理、需求文檔處理等場景中的token消耗痛點,重構Agent開發成本結構。

國產算力生態的同步進化為V4落地提供關鍵支撐。華為昇騰系列芯片在發布當日即完成全產品線適配,基于昇騰950超節點的測試數據顯示,V4-Pro在8K輸入場景下實現20ms單token解碼時延,單卡吞吐達4700 TPS;V4-Flash更將時延壓縮至10ms,單卡吞吐1600 TPS。寒武紀同步宣布完成vLLM框架適配,相關代碼當日開源至GitHub。這種芯片廠商與模型團隊的深度協同,源于DeepSeek耗時數月完成的CUDA到CANN技術棧遷移,雖導致模型多次延期,但最終實現發布即適配的生態突破。

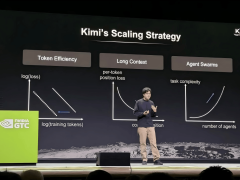

當前國產開源模型已形成集群效應。Qwen3.6 Plus、Kimi K2.6、智譜GLM-5.1等模型相繼突破百萬上下文門檻,在代碼生成、數學推理等專項能力上比肩國際頂尖水平。據國際開發者社區統計,中國開源模型的出現頻率在2026年呈現指數級增長,與算力側的適配進度形成共振。這種系統性創新能力的展現,標志著中國AI研發從單點突破邁向生態級競爭,在模型迭代、算力適配、工程優化等維度形成完整創新鏈條。